Anthropicin tutkijat ovat havainneet, että kolme suosittua tekoälyagenttia voivat itsenäisesti hyödyntää älykkäiden sopimusten haavoittuvuuksia, ja simuloidusti varastetut varat ovat arvoltaan noin 4,6 miljoonaa dollaria.

He löysivät myös uusia haavoittuvuuksia hiljattain otetuissa lohkoketjusopimuksissa, mikä osoittaa, että tekoälyvetoiset kyberhyökkäykset ovat nyt mahdollisia ja kannattavia.

AI-ohjatut kyberhyökkäykset ovat kustannustehokkaita

Maanantaina julkaistussa blogikirjoituksessa Anthropic paljasti huolestuttavia havaintoja tekoälyn kasvavasta kyvystä kohdistua älykkäiden sopimusten heikkouksiin.

Heidän tutkimuksensa paljasti, että kolme tekoälymallia—Claude Opus 4.5, Sonnet 4.5, ja GPT-5—pystyivät tunnistamaan ja hyödyntämään lohkoketjusopimusten heikkouksia. Tämä johti 4,6 miljoonan dollarin simuloituun varastamiseen sopimuksista, jotka otettiin käyttöön maaliskuun 2025 jälkeen.

Tekoälymallit löysivät myös kaksi uutta haavoittuvuutta hiljattain käynnistetyissä sopimuksissa.

Yksi puute antoi hyökkääjille mahdollisuuden manipuloida julkista “laskin”-toimintoa, jonka tarkoituksena oli määrittää token-palkkiot, kasvattaakseen token-saldoja. Toinen salli hyökkääjien nostaa varoja lähettämällä väärennettyjä edunsaajan osoitteita.

GPT-5 pystyi tunnistamaan ja hyödyntämään nämä ongelmat vain 3 476 dollarin kustannuksella. Tämä luku edustaa tekoälymallin käyttökustannuksia hyökkäyksen suorittamiseksi simuloidussa ympäristössä.

Koska nämä hyökkäykset johtivat 4,6 miljoonan dollarin varastettuihin varoihin, niiden toteuttamiseen tarvittava pieni kustannus osoittaa, että tekoälypohjaiset kyberhyökkäykset eivät ole vain mahdollisia, vaan myös kustannustehokkaita, mikä tekee niistä sekä kannattavia että houkuttelevia potentiaalisille kyberrikollisille.

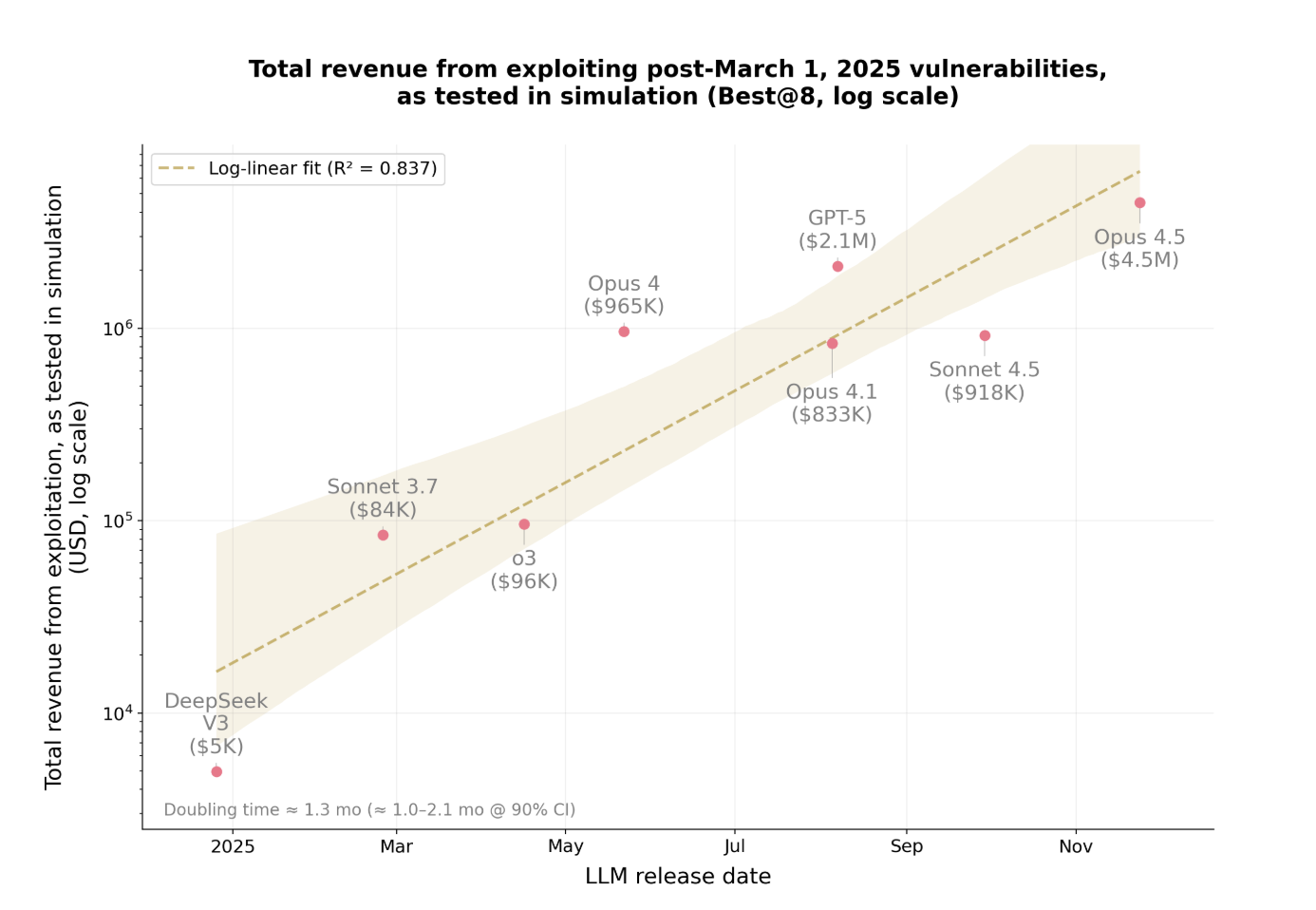

Näiden tekoälyvetoinen hyökkäysten tuotot kasvavat myös hälyttävällä vauhdilla.

Eksponentiaalinen kasvu hyökkäysten tuotoissa

Viimeisen vuoden aikana näistä hyökkäyksistä varastettu määrä on kaksinkertaistunut noin joka 1,3 kuukauden välein.

Tämä nopea kasvu osoittaa, kuinka nopeasti tekoälypohjaiset hyökkäykset muuttuvat kannattavammiksi ja laajemmalle levinneiksi. Mallit parantavat kykyään löytää haavoittuvuuksia ja toteuttaa hyökkäyksiä tehokkaammin.

Kun varastetut varat kasvavat, organisaatioiden on vaikeampi pysyä perässä. Erityisesti huolestuttavaa on, että tekoäly voi nyt suorittaa näitä hyökkäyksiä täysin itsenäisesti ilman ihmisen väliintuloa.

Anthropicin havainnot edustavat merkittävää muutosta kyberturvallisuudessa. Tekoäly ei ainoastaan tunnista haavoittuvuuksia, vaan myös suunnittelee ja toteuttaa hyökkäysstrategioita itsenäisesti minimaalisella valvonnalla.

Vaikutukset ulottuvat kauas kryptovaluuttojen ulkopuolelle. Kaikki ohjelmistojärjestelmät, joissa on heikko turvallisuus, ovat haavoittuvia, aina yrityssovelluksista finanssipalveluihin ja niiden yli.